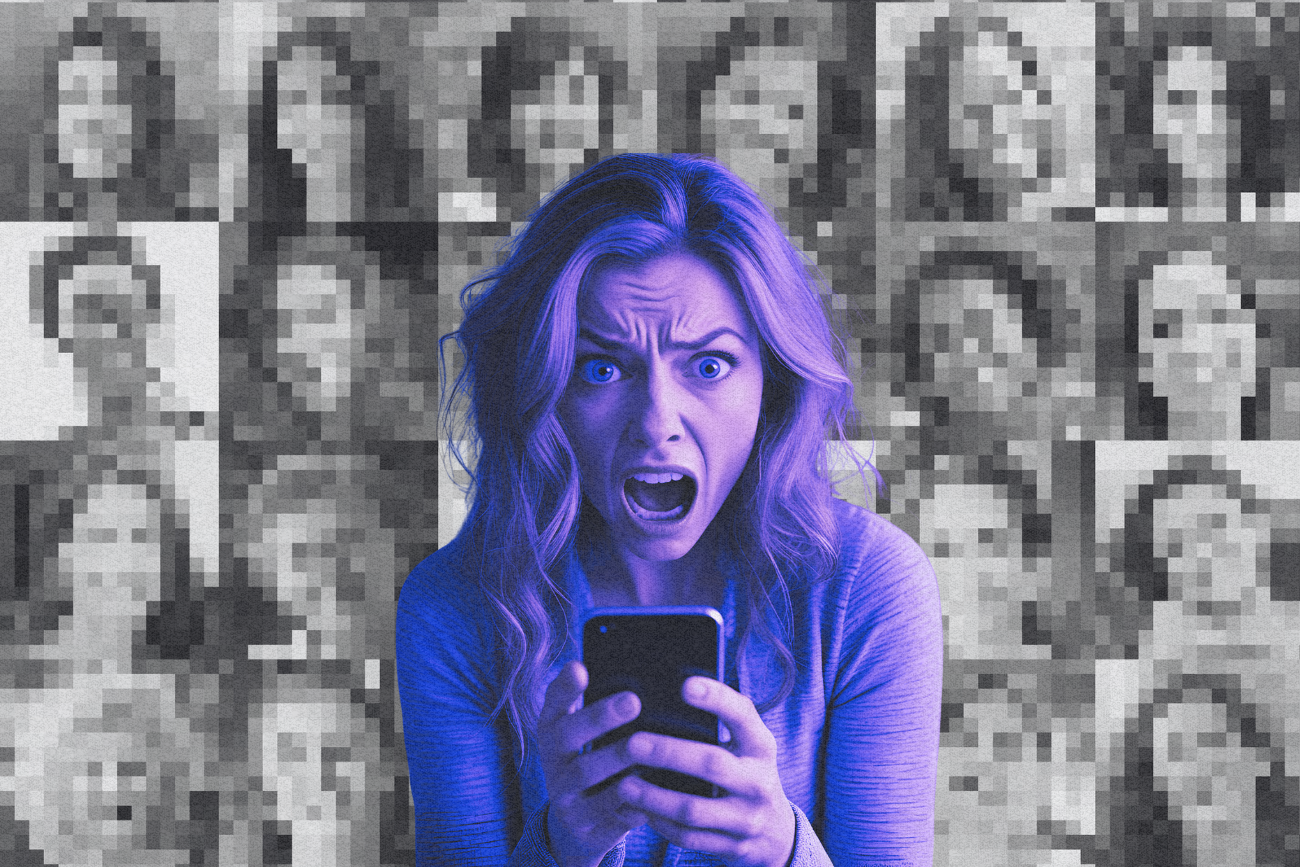

AI służąca do "rozbierania" ludzi ze zdjęć działa dziś szybciej i skuteczniej niż Photoshop. To miliony użytkowników, miliardy danych i zyski liczone w dziesiątkach milionów dolarów. Często wystarczy zdjęcie z Instagrama.

Narzędzia, które służą do "rozbierania" ludzi na zdjęciach, a nazywane bywają narzędziami nudify, nie są nowe. Od lat takie strony funkcjonują w przestrzeni internetowej i z lepszym lub gorszym skutkiem umożliwiały ten nieetyczny proceder. W końcu kiedyś do przerobienia zdjęcia wystarczył Photoshop. Dziś sztuczna inteligencja sprawia, że staje się to dużo prostsze, szybsze i powszechne.

Nudify – jak działa technologia AI

Strony nudify stały się szczególnie popularne w 2019 roku, kiedy to zaczęły powstawać pierwsze deepfake’i dobrej jakości. Kolejne lata to już gwałtowny wzrost popularności takich usług, który napędzał rozwój sztuczne inteligencji.

Przerabiane zdjęcia najczęściej pochodzą z mediów społecznościowych ofiary cyberprzemocy. Jak podaje WIRED, to m.in. nastoletni chłopcy na całym świecie tworzą dziś niechciane wizerunki swoich koleżanek z klasy.

Analiza 85 takich stron internetowych, którą przeprowadził Indicator, wykazała, że większość opiera swoje funkcjonowania na ogólnodostępnych narzędziach. To usługi technologiczne Google, Amazona czy Cloudflare. Dwie ostatnie firmy zapewniają hosting lub usługi dostarczania treści dla 62 z 85 stron internetowych, a system logowania Google’a był używany na 54 stronach.

Skala problemu rośnie: miliony odwiedzin miesięcznie i setki tysięcy wygenerowanych zdjęć

Zainteresowanych niestety nie brakuje, bo te strony w ciągu ostatniego pół roku każdego miesiąca odwiedzało średnio 18,5 mln osób. To najczęściej Amerykanie, ale kolejne miejsca należą do mieszkańców Indii, Brazylii, Meksyku i Niemiec.

Jeszcze bardziej szokuje skala zarobku, badacze szacują, że z 18 z tych witryn zarobiło w tym czasie od 2,6 do 18,4 mln dolarów. To nawet 36 mln dolarów rocznie. Główne źródło dochodu takich platform to tzw. kredyty, które można wykorzystać na generowanie zdjęć lub subskrypcje.

Analitycy Indicator dodają, że to i tak prawdopodobnie ostrożne wyliczenia, bo nie uwzględniają, chociażby transakcji odbywających się poza stronami internetowymi, m.in. przez Telegram.

Telegram jako nowe centrum dla botów nudify

Na Telegramie boty służące do generowania takich zdjęć pojawiły się po raz pierwszy w 2020 roku. Henry Ajder, ekspert od deepfake’ów odkrył wówczas narzędzie, które wygenerowało do tej pory ponad 100 tys. fałszywe zdjęć, głównie kobiet, ale niektóre przedstawiały również dzieci.

Cztery lata później magazyn WIRED przeprowadził w tej spawie śledztwo dziennikarskie. Wnioski okazały się być przytłaczające. Dziennikarzom udało się odkryć 50 botów działających w ten sposób, z których usług regularnie korzystają 4 mln osób.

To jednak prawdopodobnie jedynie kropla w morzu, bo dochodzenie dotyczyło jedynie anglojęzycznych botów. "Zrobię z przesłanym zdjęciem wszystko, co chcesz" – tak brzmią opisy niektórych z nich. Większość zachęca użytkowników do przesyłania zdjęć kobiet. Tylko pojedyncze oferują również usługę "rozbierania" mężczyzn.

Pierwsze pozwy, nowe prawo i działania gigantów

Firmy technologiczne, jak i organy ścigania wydawały się bezradne wobec ścigania twórców deepfake’ów. Jak to z rozwojem technologii bywa niemal za każdym razem, prawodawstwo zawsze zostaje daleko w tyle.

Ostatnio doszło do pewnego przełomu. Prokurator miejski San Francisco pozwał 16 serwisów oferujących usługi generowania niechcianych zdjęć. Microsoft zidentyfikował twórców deepfake'ów celebrytów, a Meta złożyła pozew przeciwko firmie rzekomo stojącej za aplikacją nudify, która, jak twierdzi Meta, wielokrotnie publikowała reklamy na ich platformie.

Kontrowersyjna ustawa Take It Down Act, którą prezydent USA Donald Trump podpisał w maju, nałożyła z kolei na firmy technologiczne obowiązek szybkiego usuwania niechcianych zdjęć, Dania nadała praw autorskich do własnego ciała Duńczyków, a rząd Wielkiej Brytanii zakazał tworzenia realistycznych deepfake'ów.

Te działania nie sprawią, że popyt, jak i sama technologia znikną. Zepchnięcie jej jednak do szarej strefy internetu sprawi, że trudniej będzie odnaleźć samą usługę, co zmniejszy jej popularność i skurczy przychody cyberprzestępców.

Zobacz także