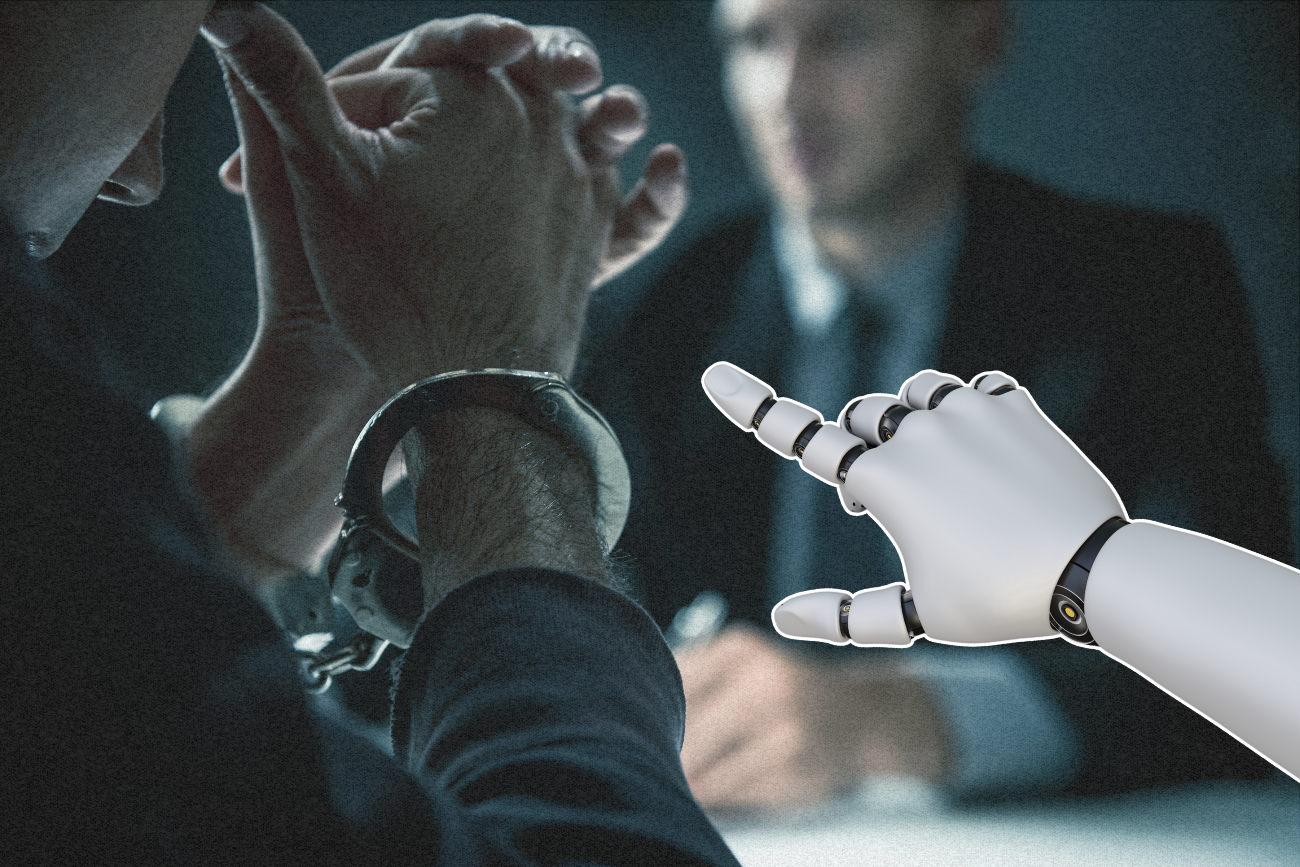

Sam Altman, szef OpenAI, potwierdził - rozmowy z ChatGPT mogą zostać ujawnione i użyte jako dowód w sądzie. Użytkownicy, którzy traktują czat jako bezpieczne miejsce do zwierzeń lub porad, mogą być zaskoczeni. ChatGPT nie chroni cię tak jak lekarz czy prawnik.

Wielu użytkowników traktuje ChatGPT jako narzędzie codziennej pomocy — prosząc o porady prawne, emocjonalne wsparcie czy analizę prywatnych dokumentów. Jednak dyrektor generalny OpenAI, Sam Altman, wywołał poruszenie, przyznając publicznie, że treść takich rozmów może zostać użyta przeciwko użytkownikowi w postępowaniu sądowym. W przeciwieństwie do kontaktów z lekarzem, psychoterapeutą czy prawnikiem, interakcje z chatbotem nie są chronione żadną tajemnicą zawodową.

Brak tajemnicy zawodowej. ChatGPT nie jest terapeutą

"Jeśli rozmawiasz z ChatGPT o swoich najbardziej wrażliwych sprawach i dochodzi do postępowania, możemy zostać zobowiązani do ich ujawnienia" — powiedział Altman w podcaście This Past Weekend.

Rosnąca liczba użytkowników korzysta z ChatGPT jako nieformalnego terapeuty. Choć pozornie wygodne, takie podejście może być ryzykowne. Chatbot nie potrafi ocenić emocjonalnego kontekstu wypowiedzi, a dane wprowadzone do systemu mogą być przechowywane nawet przez 30 dni, mimo usunięcia ich przez użytkownika.

Jeśli pojawi się uzasadniony wniosek prawny lub zagrożenie bezpieczeństwa, OpenAI ma prawo zatrzymać i przekazać te informacje odpowiednim organom.

Obecnie prawo nie przewiduje dla chatbotów statusu zbliżonego do zaufanych zawodów. To oznacza, że firmy takie jak OpenAI muszą ujawniać dane rozmów, jeśli zobowiąże je do tego sąd. Sam Altman przyznaje, że coraz więcej osób korzysta z AI do omawiania problemów osobistych i zdrowotnych, co jego zdaniem "wymaga pilnej regulacji prawnej".

Wirtualna prywatność to iluzja

Wielu użytkowników ma złudne poczucie prywatności, wpisując do ChatGPT poufne informacje. Tymczasem polityka OpenAI pozwala na analizowanie rozmów w celu poprawy modelu i wykrywania naruszeń regulaminu. Firma zastrzega sobie prawo do przechowywania treści nawet po usunięciu ich z konta użytkownika, jeśli wymaga tego prawo lub względy bezpieczeństwa publicznego.

Altman nie ukrywa, że rozwój AI wyprzedza możliwości prawodawców. Jeszcze rok temu rozmowy z chatbotem nie były traktowane jako potencjalny dowód. Dziś to realna opcja.

Rozmowa z chatbotem może być wygodna i szybka, ale nie oznacza, że jest bezpieczna — szszczególnie gdyprawa trafia do sądu.

Zobacz także